Cloaking and Penalty

Cloaking: Black-Hat-Technik aus dem PPP-Bereich?

(PPP = Porn, Pills, Poker)

Cloaking: Suchmaschinen bekommen anderen Inhalt ausgeliefert als die Besucher.

Nur wer die Gefahr/Technik kennt, kann sich auch schützen!

In vielen Bereichen ist es nicht möglich die Richtlinien einzuhalten.

Im PPP-Bereich folgt fast niemand den Regeln!

Auch im Affiliate-Bereich nimmt man es häufig nicht so „genau“.

Es gibt keine Gesetze die das verbieten!

Es gibt keine Entschuldigung, warum man Black-Hat-Strategien angewandt hat, wenn man im Filter ist oder eine Strafe hat, muß man ehrlich mit sich selbst sein und es akzeptieren.

Sicherstellen, daß man einen guten Plan B hat:

Wenn man damit rechnen muß, daß die Seite aus dem Index fliegt, hat man besser die nächste Seite bereits vorher fertig.

Läuft etwas falsch?

Ist die Webseite merklich langsamer geworden?

Sicherstellen, daß Web-Server überwacht. Server-Software und alle Anwendungen immer updaten! Ein Auge auf die Software-Hersteller werfen, beobachten – laufend!

Hat der Hoster Änderungen am Netzwerk vorgenommen zB php-update?

Überwachen in den WMT: Crawl-Stats dürfen keine hohen Spitzen haben!

Wurden Änderungen an der Webseite vorgenommen?

CMS bzw System, URLs, Udates, neue Programmierungen

- Sind neue Programmierungen erfolgt am CMS?

- Wurden Updates am CMS vorgenommen?

- Wurden die URLs verändert?

- Wurde irgendein neuer Code hinzugefügt?

Hat sich die Absprungrate (Bounce-Rate) oder der Qualitäts-Faktor (schlechter) geändert?

Verlassen mehr Besucher die Webseite?

verbringen Sie weniger Zeit dort, sehen weniger Seiten an?

Wurde die Seite gehackt?

Kommt immer häufiger vor.

Automatisierte Sicherheits-Scans finden nicht alles – Rat von Experten holen!

Nicht voreilig einen Reconsideration Request stellen – erst Seite komplett aufräumen!

Test z.B über „Malware review“ in den WMT: vollautomatischer Rescan der Seite, Ergebnis hat man schnell (normalerweise innerhalb von 24h).

Keine Wiederaufnahme starten bevor nicht 100% alles ok ist!

Die Seite im Google-Safe-Browser überprüfen: www.google.com/safebrowsing/diagnostic?site=deineseite.de

Tools:

Google Cache, Translation Tools, Lynx Text Browser, Xenu Link Slueth, WebBug HTTP Viewer (www.cyberspyder.com/webbug.html), FireFox Web Browser User Agent, Domain Tools (www.domaintools.com), Live HTTP Header Plugin

- Cloaking-Check (http://best-seo-tools.net/cloaking/)

- IP-Delivery (redir.ec/geolocation)

- Malware-Report (redir.ec/mwreport)

- GeoLocation Database (redir.ec/geodb)

Cloaking-Methoden

Generell:

Keinen verborgenen Content für Suchmaschinen bereitstellen, viele Besucher der Website können Elemente unter Umständen auch nicht sehen.

Beispiel Bilder:

Bilder besser mit Alt-Text zur Verfügung stellen für Besucher die Bilder im Browser deaktiviert haben (auch für Besucher mit Bildschirmleseprogramm).

User-Agent Cloaking

„User-Agent“ ist der Name der Anwendung, die diese Seite aufrufen will, ein Browser oder ein Spider.

Suchmaschinen und Besucher erhalten verschiedene Inhalte einer Webseite weil sie verschiedene Browser-Typen verwenden.

-> dafür ist ein Bespiel vorhanden und darauf gehen wir später konkret ein

IP-Adressen Cloaking

Aufgrund der IP-Adresse wird unterschiedlicher Inhalt ausgegeben -> Spider und Bots haben eigene IP-Adressen, Listen sind im Internet en masse verfügbar.

Bevor die Seite ausgegeben wird, wird überprüft von welcher IP-Adresse die Anfrage kommt. Ist es die bekannte IP eines Bot stellt der Browser etwas anderes dar als der normale User mit seinem Telekom-Zugang sieht.

Java-Script Cloaking

Die Verwendung von JavaScript ist eine absolut legitime Vorgehensweise im Web.

Elemente auf Webseite die nicht von Suchmaschinen gecrawlt werden können:

- Rich Media-Dateien die nicht auf Flash basieren, JavaScript oder Bilder

Wenn der Googlebot eine Seite mit JavaScript indexiert, wird zwar die Seite in den Index aufgenommen, der Googlebot kann jedoch Links, die im JavaScript selbst verborgen sind, weder verfolgen noch indexieren.

Google empfiehlt: Text der JavaScript-Elemente zusätzlich in einem noscript-Tag bereitstellen.

Sicherstellen: durch beide Elemente muß der gleiche Content bereitgestellt werden

-> JavaScript-Text soll genau dem Text im noscript-Tag entsprechen

Wenn bei alternativen Elementen stark abweichenden Content verwendet wird, sieht sich Google unter Umständen gezwungen, Maßnahmen bezüglich der Website zu ergreifen.

JavaScript ist oft auch für Besucher ein Problem: viele haben JS deaktiviert!

HTTP-Referer Header Cloaking

Referer Allgemein: bei der Methode wird überprüft, woher der Besucher kommt und je nachdem wird eine bestimmte Seite ausgegeben. Kommt der Besucher aus Google wird Variante 1 ausgegeben, kommt der Besucher aus eigenen Lesezeichen oder direkte Eingabe wird Variante 2 ausgegeben usw.

HTTP-Referer Accept-Language Header Cloaking

Große Seiten nutzen das häufig für Sprachsteuerung: es wird erkannt und die Webseite in der Sprache des Besuchers ausgegeben. Die Sprache wird dabei aus dem Browser ausgelesen und der entsprechende Inhalt angezeigt. Auch damit läßt sich böses treiben…

Google-Cloaking

Über GEOlocation wird angepaßter (Stichwort: targeted) Inhalt an die Besucher ausgegeben bzw über IP-Delivery basieren über die IP-Adresse des Besuchers.

Legale Cloaking-Anwendungen

- Browser-Versions-Abfrage und entsprechende Präsentation (gerade im Mobile-Bereich, IE größtes Problem für zB Programmierer)

- Spracherkennung /-bestimmung

- Session-IDs und andere komplexe Sachen (Cookies)

Beispiel: Hotel-Suche in Berlin bzw in München bringt andere Ergebnisse

Bild-Beispiel Snippet

„User-Agent“ ist der Name der Anwendung, die diese Seite aufrufen will, ein Browser oder ein Spider.

This Site may be compromised.

Würden Sie Ihre Kreditkarte auf dieser Seite einsetzen?

Bild-Beispiel Viagra

Über spezielle Programme (Googlebot-Spoofer) kann man die Bots von Suchmaschinen imitieren und sieht den Inhalt, den die Suchmaschinen auch sehen – was man normalerweise eben nicht sieht.

Bild-Beispiel Keywords

viagra, generic, sildenafil citrate, cialis

Bild-Beispiel Sichtbarkeit SEOlytics

Rankings brechen ein, Google mag kein Viagra…

Spam-Typen

Cloaking

-> behandeln wir gerade.

Unsichtbarer Inhalt

Versteckter Inhalt (Keyword-Phrasen) für die Besucher mit Hilfe der Positionierung (CSS) oder gleiche Text- wie Hintergrundfarbe.

Niemals im CSS: diplay:hidden -> Bots entdecken das sofort

Beispiel xxx-Shops: empfohlene SEO-Agentur SEOxxx aus Köln

Setzen Links über CSS in den Shop des Kunden ein und verlinken auf eigene Webseite mit Keyword „Suchmaschinenoptimierung“

Keyword-Stuffing

Stopfen mit Keywords (Schlüsselwörtern) und/oder UMSCHREIBUNGEN.

Doorway-Pages / Sneaky redirects

Meist Keyword und/oder Link-gepflasterte Webseiten ohne Wert (MFA-Seiten) welche via JavaScript weiterleiten.

Scraper Sites

Inhalt (Content) wird geklaut (scraped) von anderen Seiten (DC), meistens gestopft mit Werbung AdSense oder Java-Script-Redirects.

Article Spinning

Umschreiben von existierenden (scraped) Inhalten um DC-Strafen zu entgehen, meistens mit Hilfe von automatisierten Tools oder über Texter.

Link Spam

Die üblichen Verdächtigen:

- Kommentar-Spam

- automatisierter Link-Aufbau

- Spam-Blogs

- Wiki-Spam

- Link-Farmen

- versteckte Links

Multiple-Domains und Sub-Domains Strategie

Richtig gemacht eine richtige Strategie! (gut für Brand-Protect)

Voraussetzung:

Gute bis sehr gute SEO-Strategie die garantiert daß der Inhalt JEDER Seite gut genug (unique) ist, damit die Seite für sich allein bestehen kann.

Bei Fehlern:

Wer übertreibt kann Strafe für DC bzw Link-Farm-Penalty bekommen (Normalerweise bei DC -> Filter, keine Penalty)

Duplicate-Content-Probleme

1. Strukturelle + Inhaltliche Identität

Jede Seite von Webseite A hat die gleiche Dateigröße, das gleiche strukturelle Layout und den gleichen Inhalt wie Seite B.

-> FILTER

2. Strukturelle Gleichheit, Inhalt sehr ähnlich

Jede Seite auf Webseite A ist strukturell im Aufbau gleich und der Inhalt sehr ähnlich.

-> FILTER

3. Strukturelle Gleichheit, Inhalt ähnlich

Jede Seite auf Webseite A ist strukturell im Aufbau gleich und der Inhalt ähnlich.

-> FILTER – teilweise Strafe auf bestimmten Inhalt

4. Teilweise gleiche Struktur, Inhalt ähnlich

Manche Seiten auf Webseite A haben das gleiche strukturelle Layout; der Inhalt ist ähnlich wie auf Webseite B.

-> Strafe auf bestimmten Inhalt ist möglich und/oder Filter auf bestimmten Inhalt

Penalized

Bevor man es in Ordnung bringen kann, muß man erstmal genau wissen was passiert ist:

Warnsignale I

- Webseite kann nur direkt über die URL gefunden werden (alle Rankings „verschwunden“)

- Backlinks werden weniger

Warnsignale II

- dramatischer Rückgang der Besucher über Suchmaschinen

- Google WMT Meldungen ignoriert oder WMT nicht eingebaut (wer macht was?)

- einbrechende Rankings

- drastische Veränderungen beim PR (von 7 auf 1) innerhalb weniger Wochen oder Monate

- kompletter Verlust des PR

- weniger Seitenzahlen im Google-Report

- keine Weiterleitungen von Google in den letzten Monaten

Algorythmische Veränderungen

WICHTIG: Veränderungen laufen dauernd, immer ab.

- Hauptsächlich große Seiten sind davon betroffen

- Wer für Besucher optimiert wird davon kaum betroffen sein

- Wer betroffen ist: Veränderungen der letzten Zeit (Wochen, Monate) genau anschauen, anpassen, SEO-Strategie neu überdenken und Vorsichtig sein mit Blog-Beiträgen etc. Vertraue nichts was dazu gepostet wird (zumindest nicht 1:1 oder 100%)

Es kommt drauf an: viele öffentliche Informationen sind nicht aussagekräftig und können leicht falsch bzw unpassend interpretiert werden.

Filter

Filter sind nicht das gleiche wie automatische oder manuelle Strafen, Filter sind keine Strafen!

- für Sachen wie DC wird man nicht gestraft, man wird gefiltert

- bis sich ein Filter auf die Seiten bzw die Webseite legt dauert es oft sehr lange

- Problem/e lösen und warten bis der Filter sich von alleine wieder aufhebt – dann ist alles gut

- Filter laufen nicht alle in Echtzeit!

- Schnellere Wiederaufnahme durch neue Links und frisches SMO

Automatische und manuelle Strafen (Penalty)

Vielleicht wirklich durch eine Strafe betroffen? Das passiert allerdings nicht so oft wie man annehmen könnte! Die anderen 2 Gründe (Algo und Filter) sind häufiger als dieser!

Meistens sind es automatische Strafen:

- versteckter Text und versteckte Links

- Sneaky Redirects

- Affiliate-Tools etc

Google WMT-Notizen beachten: häufig wird man informiert bzw. kann erste Anzeichen vorzeitig erkennen.

Aufräumen und die Strafe hebt sich auf (normalerweisen innerhalb von 30 Tagen)

Site-Performance und Crawl-Stats geben Auskunft: sollten dauernd überwacht werden, das als erstes checken.

Manuelle Strafen = schlimmste Strafen!

Entweder Reconsideration Request stellen oder lange, lange, lange Zeit warten.

Google WMT: google.com/webmasters/tools/reconsideration

Die kaputte Seite reparieren:

Code aufräumen!

- Überprüfen bzw wissen was reingehört und was nicht

- Code abgleichen mit jedem Element auf der Seite!

- Alle doorway-Pages etc rausschmeißen

- Alle genutzten Techniken auf der Webseite überprüfen: JavaScript, CSS etc überprüfen

Wenn Sie dich zurück in den Index lassen – > NEVER EVER AGAIN!

100% brutal ehrlich sein: was passiert ist, was man falsch gemacht hat, wer es gemacht hat (Programmierer, Unternehmen, Software etc) und was man jetzt geändert hat damit die Seite wieder den Richtlinien entspricht.

Niemals wieder tun – und das auch versprechen!

Suchmaschinen haben eine inoffizielle „Two-Strikes-Policy“ – 1. Mal ja, beim 2. Mal NEIN

Penalized? – Maybe Not!

Änderungen auf der Webseite bzw auf dem Markt

Haben Mitbewerber ihre Seite verbessert, haben sie mehr Links aufgebaut?

-> Markt beobachten (Monitoring), auch die sozialen Plattformen (Facebook und Twitter Links)

Sind neue, bessere Webseiten dazugekommen, hat sich der Markt verändert?

-> Keywords beobachten (Monitoring)

Sind neue Videos etc veröffentlicht worden?

-> Mitbewerber-Aktivitäten beobachten

Fehlerquellen:

- HTTPS – sichert die ganze Seite

- User Redirect – (JavaScript Mouseover)

- HT-Access – sperrt alle aus?

- Country Redirects

- Links leiten falsch um

- robots.txt

Wie man auf das Radar kommt:

- Besucher werden automatisch auf die Startseite geleitet -> Redirects?

- Doorway Pages -> Testseiten für Layout? Marketing-Seiten mit zuwenig Text?

- Generell: Seiten die keinen exakten Hintergrund haben außer Besucher auf andere Seite weiterleiten

- Normalerweise zB ein 1×1 clear GIF das auf die Seite verlinkt und weiterleitet, 100% versteckt im Frameset

- Keyword-Stuffing: 5 Mal fast die gleiche Seite mit jeweils 20 Keywords?

- Domain-Umzug: Neue Webseiten-Adresse? -> Domain-Spam

Wie man sich schützen kann:

Server-Software und alle Anwendungen immer up-to-date halten!

Software-Anbieter prüfen (Beispiel: WordPress-Templates mit versteckten Links)

Webseite regelmäßig überprüfen!

Nicht auf automatische Scans verlassen.

Jemanden im Unternehmen dafür verantwortlich machen!

Ruhe bewahren!

Cloaking and Penalty

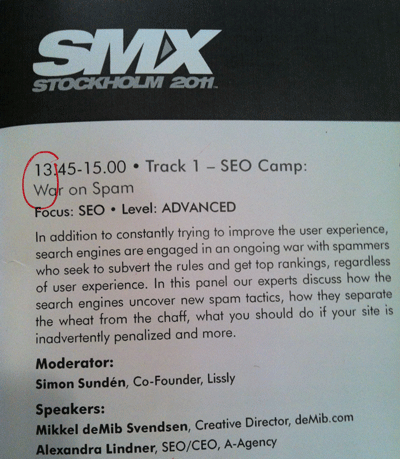

Mein Vortrag von der SMX in Stockholm (zusammen mit Mikkel de Mib „War on Spam“) und SEO-Campixx (Berlin) über Cloaking und Penalty, den ich leider in einer Prezi-Beta erstellt hatte und deshalb nie online stellen konnte. Zwei Mal hatte ich versucht das Format umzuwandeln in PowerPoint oder irgendwas, aber dann hab ich irgendwann aufgegeben.